La IA Generativa emerge como una herramienta fascinante con posibilidades interminables tanto para usuarios como para desarrolladores de plataformas digitales y negocios. Pero es necesario considerar que es tecnología que puede ser aprovechada por actores maliciosos.

La Inteligencia Artificial (IA) se ha posicionado como el estandarte de una revolución tecnológica sin precedentes.

Hoy en día, si te tomas un momento para observar, es prácticamente imposible no notar el progreso de la IA en el ecosistema digital a través de varios tipos de tareas.

Desde la creación de imágenes divertidas de un anuario de los 90, hasta tareas enfocadas en mejorar la productividad y los procesos de flujo de trabajo.

La IA está en todas partes.

Del ChatGPT al HackGPT: Qué hacer frente a la ciberamenaza de la IA generativa

Los riesgos en materia de ciberseguridad

Si bien es una herramienta tecnológica con un potencial increíblemente alto en términos de desarrollo de plataformas digitales, crecimiento empresarial y optimización de procesos, también conlleva riesgos significativos.

Uno de estos riesgos ya es tangible: en un informe reciente, el Foro Económico Mundial indica que la desinformación basada en la IA se posicionará como el principal riesgo global de 2024.

La IA Generativa se presenta como una innovación marcada por la dualidad.

Por un lado, su capacidad para la innovación y por el otro, el potencial para alimentar crímenes cibernéticos sofisticados como la creación de deep fakes y el robo de identidad.

Esto se debe a la naturaleza expansiva de la IA, ya que esta herramienta permite la manipulación de información a una escala sin precedentes.

Desinformación en elecciones 2024, ¿qué harán los gigantes como Google para combatirla?

¿Cómo abordar estos riesgos?

La naturaleza de la IA Generativa, que puede procesar y generar datos a gran escala y de formas innovadoras, requiere el enfoque de ciberseguridad más completo de hoy, que sea igualmente sofisticado, estricto y adaptable.

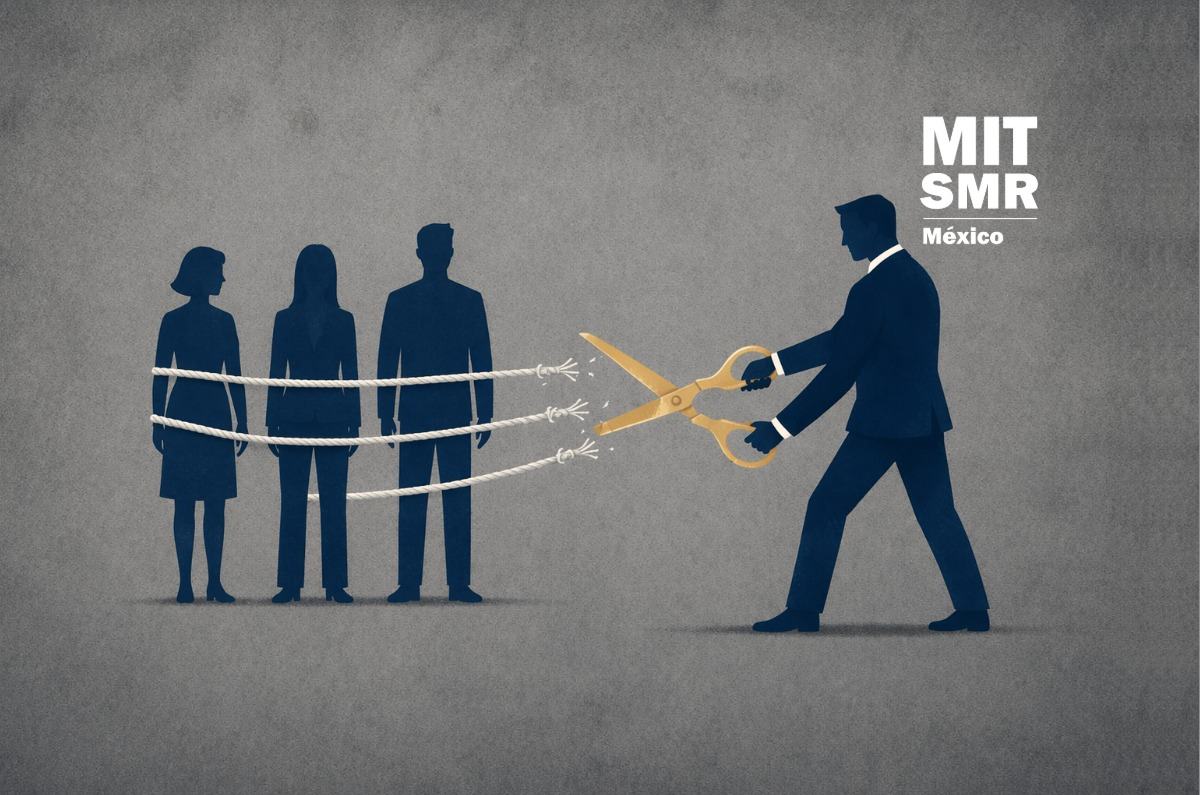

El modelo de Zero Trust (Confianza Cero) se basa en el principio de nunca confiar, siempre verificar.

Por lo tanto, en entornos donde la IA Generativa puede usarse para generar o manipular información sensible, protege contra posibles actores maliciosos externos al verificar continuamente y de manera contextual todos los accesos, usuarios y dispositivos conectados a una red.

Además de Zero Trust, es prudente establecer límites en el número de veces que cualquier usuario puede hacer solicitudes a las API.

Esto no solo protege los sistemas y redes corporativos contra el mal uso de las claves de API, sino también contra errores de programación que podrían resultar en una vulnerabilidad para el usuario final.

Sumado a ello es crucial enfatizar la necesidad de concienciar en todas las organizaciones, así como en los usuarios de Internet del mundo, sobre los riesgos asociados con la IA Generativa.

Se requiere un enfoque proactivo para la educación y la cultura de seguridad dentro de las organizaciones, donde cada individuo esté empoderado para actuar como un eslabón crítico en la defensa contra los ciberataques.

IA podría robar tu contraseña al escuchar tu teclado, el futuro de los ciberataques

Protección, el primer paso

Ante la constante evolución de las ciberamenazas, las empresas deben asegurarse de que todos los colaboradores sean capaces de cuestionar y reconocer intentos de phishing que usan textos generados por IA, y entender la importancia de no compartir información sensible sin las precauciones adecuadas.

La IA Generativa emerge como una herramienta fascinante con posibilidades interminables tanto para usuarios como para desarrolladores de plataformas digitales y negocios.

Pero es necesario considerar que es tecnología que puede ser aprovechada por actores maliciosos, lo que obliga a todos los actores en la ecuación a adoptar un papel proactivo y adaptarse a la evolución de las amenazas con el objetivo de crear entornos digitales más seguros.

SOBRE AL AUTOR INVITADO

Carlos Torales es VP para LATAM de Cloudflare.

Te recomendamosCarlos Torales

Carlos Torales es VP para LATAM de Cloudflare.y recibe contenido exclusivo