La iniciativa de Inteligencia Artificial Responsable examina cómo las organizaciones definen y abordan las prácticas, políticas y normas de IA.

MIT Sloan Management Review y el Boston Consulting Group (BCG) han reunido un panel internacional de expertos en Inteligencia Artificial que incluye a académicos y profesionales para ayudarnos a comprender cómo se está aplicando la inteligencia artificial responsable (RAI) en las organizaciones de todo el mundo.

A menudo se dice que la RAI crea fricciones que ralentizan el ritmo de desarrollo de los productos y ahogan la innovación. Queríamos saber si los líderes encargados de desarrollar soluciones de IA han experimentado este fenómeno.

Piyush Gupta, CEO de DBS Bank: retrato de un líder en Inteligencia Artificial

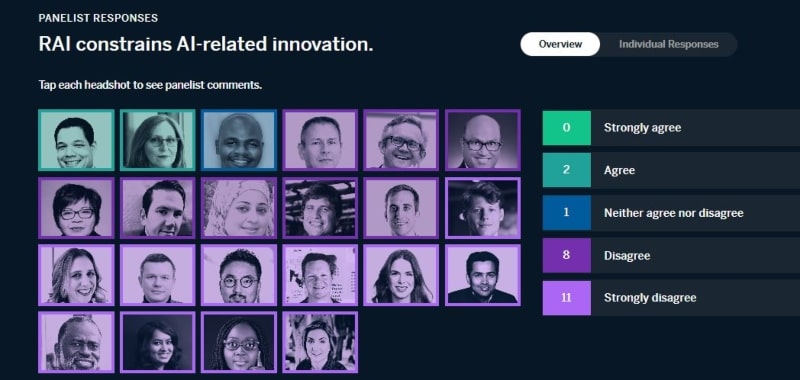

Este mes, pedimos a nuestros panelistas que reaccionaran a la siguiente provocación: La RAI limita la innovación relacionada con la IA.

Los resultados fueron casi unánimes, con un 86% (19 de 22) de nuestros panelistas estuvieron en desacuerdo o muy en desacuerdo con la afirmación.

De hecho, nuestros expertos afirmaron de forma abrumadora que la RAI en realidad permite el crecimiento y la innovación relacionados con la IA, o al menos el tipo de innovación que desean, aunque sus razones difieren.

También realizamos una encuesta mundial a más de 1,000 ejecutivos sobre el tema de la RAI y encontramos un apoyo análogo a la opinión de que los esfuerzos de RAI promueven mejores resultados empresariales, incluida la innovación acelerada.

Casi el 40% de los directivos de empresas con al menos 100 millones de dólares de ingresos anuales declararon que ya están experimentando una aceleración de la innovación como resultado de sus esfuerzos de RAI, mientras que el 64% de los directivos de organizaciones con programas maduros de RAI (con líderes de RAI) describieron un impulso similar.

Más del 40% de los encuestados observaron una mejora de los productos y servicios como resultado de sus esfuerzos de RAI. Esta cifra se eleva al 70% entre los líderes de RAI.

A continuación, compartimos las opiniones de nuestros panelistas. También nos basamos en nuestras propias observaciones y en nuestra experiencia trabajando en iniciativas de RAI para ofrecer recomendaciones a las organizaciones que buscan aprovechar la RAI para apoyar el crecimiento y la innovación relacionados con la IA.

Suscríbete a nuestro newsletter en LinkedIn

La IA puede ser neutral, pero la RAI no lo es

Los expertos de la industria y la política a menudo describen la ética y las regulaciones tecnológicas como obstáculos para la innovación. Por ejemplo, los que perciben una carrera armamentística de la IA entre Estados Unidos y China suelen citar la ética de la IA como un obstáculo para el despliegue novedoso de la tecnología.

Nuestros panelistas rechazan este punto de vista y se oponen a lo que significa la innovación en el contexto de la RAI.

Distinguen entre las innovaciones en la propia tecnología de la IA y las innovaciones sociotécnicas que permiten a la IA potenciar a los seres humanos.

En su opinión, la RAI permite un progreso social beneficioso, lo que podemos considerar una verdadera innovación, y limita los impactos potencialmente perjudiciales de los avances en la IA.

Como afirma Richard Benjamins, jefe de estrategia de IA y datos de Telefónica, “la inteligencia artificial, por sí misma, no es responsable ni irresponsable. Es la aplicación de la IA a casos de uso específicos lo que la hace responsable o no”, y ahí es donde entra en juego la RAI.

Esencialmente, si la innovación de la IA pregunta qué es posible, la innovación de la RAI pregunta qué debería ser.

Totalmente en desacuerdo

“La práctica de la IA responsable no está en absoluto reñida con la innovación. Ambas pueden y deben coexistir. La innovación no sólo consiste en dar rienda suelta a la imaginación y lograr lo que antes no era posible; se trata de hacerlo con ética, valores y respeto a los derechos. Cuando la innovación y la responsabilidad se combinan, vemos el mayor potencial de la tecnología y la inteligencia humana (incluida la emocional), y ambas -juntas- lograrán lo que no puede triunfar por sí solas.”

Katia Walsh, Levi Strauss & Co.

Nuestros panelistas reconocen que, como cualquier tecnología, la IA tiene el potencial de producir resultados sociales tanto positivos como negativos.

Para muchos de nuestros expertos, la RAI consiste en maximizar las ventajas y minimizar los inconvenientes de las aplicaciones de la IA. Como observa Paula Goldman, directora de uso ético y humano de Salesforce, “la IA tiene el poder de transformar la forma en que vivimos y trabajamos de manera profunda, pero también hemos visto que exacerba las desigualdades sociales”.

Y añade: “Invertir en principios y barreras de seguridad puede liberar el potencial positivo de la IA al mitigar los daños y generar confianza.”

Para Benjamins, “la IA responsable es una mentalidad y una metodología que ayuda a centrarse en innovaciones que maximizan los impactos positivos y minimizan los negativos.”

Riyanka Roy Choudhury, investigadora de la Universidad de Stanford, está de acuerdo y afirma que “la IA responsable crea una guía para mitigar los riesgos de la IA” y que “cuando se adopta universalmente, la IA responsable puede abrir nuevas oportunidades que conduzcan a una IA más justa y sostenible”.

Por qué las empresas deben adoptar prácticas responsables con la Inteligencia Artificial

La RAI pone la IA en contexto

Para lograr un impacto positivo neto, debemos distinguir entre la evolución de la IA como tecnología y el progreso posibilitado por la RAI como fenómeno social.

Mientras que los avances de la IA son matemáticos, computacionales o técnicos, la RAI considera cómo su aplicación afecta a los seres humanos a nivel individual y social.

Esta es quizás la dimensión más importante a tener en cuenta, ya que a menudo es la combinación de seres humanos más IA la que genera el mayor valor.

Por ejemplo, David Hardoon, director de datos y de IA del UnionBank de Filipinas, enmarca la distinción en una pregunta: “¿La RAI limita la innovación relacionada con la IA? En el contexto de la innovación matemática de la IA, sí, hasta cierto punto”.

Del mismo modo, Oarabile Mudongo, investigador del Center for AI and Digital Policy de Johannesburgo, nos insta a examinar “el contexto sociohistórico de la innovación tecnológica, ya que los avances de la IA causarán trastornos de gran alcance en la sociedad” y no pueden evaluarse de forma aislada.

Aunque no hay duda de que la IA cambiará la sociedad, son las limitaciones que imponemos las que determinarán cómo.

Como observa Belona Sonna, candidata al doctorado en el programa de Humanización de la Inteligencia Artificial de la Universidad Nacional de Australia, “la RAI es la forma de acoplar el poder computacional de la IA con la dimensión social necesaria para mejorar la vida de las personas”.

Ella nos desafía a preguntarnos: “¿Qué es lo que realmente importa? ¿Demostrar el poder computacional de los modelos o poner ese poder computacional en beneficio de los seres humanos?“.

Nuestros panelistas coinciden de forma abrumadora en que el tipo de innovación relacionada con la IA que importa es la que beneficia a las personas, a las empresas y a la sociedad en su conjunto, y las limitaciones son la forma de conseguir esos beneficios.

Totalmente en desacuerdo

“Estamos construyendo tecnología de inteligencia artificial en beneficio de la humanidad, por lo que las limitaciones de la IA deben formar parte del diseño. La RAI nos permite plantear preguntas de investigación más interesantes y aprender a recopilar datos correctamente, al tiempo que nos aseguramos de no marginar a grupos y comunidades. No limita la innovación, sino que crea más, lo que requiere conocimientos adicionales”.

Jeremy King, Pinterest.

IA responsable y responsabilidad social corporativa: una mezcla difícil de conseguir

La IA responsable mejora la innovación en lugar de limitarla

El profesor asociado de ética empresarial de Carnegie Mellon, Tae Wan Kim, observa que “las limitaciones de la IA responsable son actualmente las principales fuerzas de la innovación relacionada con la IA“.

Nuestros expertos señalan numerosas pruebas de las formas en las que la IA promueve innovaciones que benefician a los individuos, a los resultados empresariales y a la sociedad en general.

Philip Dawson, miembro del Instituto Schwartz Reisman para la Tecnología y la Sociedad, sostiene que “la RAI está acelerando el tiempo de comercialización para las organizaciones que buscan obtener los beneficios de la IA para sus negocios y, como resultado, ha llevado a la innovación de toda una nueva industria”, citando “la aparición de un mercado cada vez más grande y en expansión de proveedores de RAI SaaS (software como servicio)”.

Linda Leopold, jefa de IA y datos responsables del Grupo H&M, está de acuerdo en que las empresas se benefician de la RAI, señalando que “las soluciones de IA diseñadas de forma ética y responsable son también mejores soluciones de IA en el sentido de que son más fiables, transparentes y se crean teniendo en cuenta los intereses del usuario final”.

Además, sostiene que para las empresas la IA “crea una ventaja competitiva, ya que reduce el riesgo y aumenta la confianza”.

Además de promover los resultados beneficiosos de las aplicaciones de IA, la RAI ayuda a prevenir o mitigar los posibles daños.

Tshilidzi Marwala, vicerrector de la Universidad de Johannesburgo, sostiene que “centrarse en la regulación, la ética y los aspectos culturales de la IA no obstaculiza la innovación en su conjunto, sino que aborda las preocupaciones en torno a la innovación perjudicial”.

Aunque esto podría significar la ralentización o incluso la renuncia a ciertas aplicaciones de la IA, en realidad es un resultado deseable, desde el punto de vista de la RAI.

Como dice Simon Chesterman, director senior de gobernanza de la IA en AI Singapur, “el propósito de la RAI es cosechar los beneficios de la IA al tiempo que se minimiza o mitiga el riesgo mediante el diseño, el desarrollo y el despliegue de la IA de manera que ayude a los humanos en lugar de perjudicarlos”.

Del mismo modo, Hardoon observa que “la RAI limita la innovación relacionada con la IA tanto como las normas de tráfico limitan la velocidad máxima a la que puede circular un coche por las carreteras”.

Los beneficios culturales de la inteligencia artificial en la empresa

Recomendaciones

La RAI permite la innovación relacionada con la IA porque aborda la aplicación y el impacto de la IA en el mundo real, y ese es el único contexto en el que la innovación realmente importa.

Como resume Suhas Manangi, jefe de producto del equipo de la plataforma de defensa de IA/ML de Airbnb, “¿Podemos construir un mundo equitativo construyendo una IA equitativa? ¿Y no es esa la innovación, y la única, que queremos? Si es así, la IA responsable ayuda a esa innovación, pero no la limita”.

En resumen, para las organizaciones que buscan aprovechar la IA para promover la innovación relacionada con la IA, recomendamos lo siguiente:

- No permitir que la novedad se convierta en una barrera. La RAI no limita la innovación relacionada con la IA, y hay muchas pruebas que apoyan lo contrario. No permitas que se convierta en una excusa para retrasar las iniciativas de RAI dentro de tu organización.

- Concéntrate en las ventajas de la RAI. Al ampliar un programa de RAI, manténte centrado en el panorama general: La RAI permite obtener claros beneficios empresariales, genera confianza con los clientes y promueve resultados sociales beneficiosos.

- No todas las innovaciones son iguales. Recuerda que no todo lo que se puede hacer debe hacerse, y eso es cierto para la IA. Piensa en el legado que quieres dejar y utiliza la RAI para dar forma a ese legado por el bien de la humanidad.

SOBRE EL PANEL

El MIT Sloan Management Review y el Boston Consulting Group han reunido a un grupo internacional de más de 20 profesionales de la industria, académicos, investigadores y responsables políticos para que compartan sus puntos de vista sobre cuestiones fundamentales relacionadas con la IA responsable. A lo largo de cinco meses, pediremos a los panelistas que respondan a una pregunta sobre la IA responsable y expliquen brevemente su respuesta. Los lectores pueden ver todas las respuestas de los panelistas y los comentarios en el panel que aparece al final de cada artículo y continuar el debate en AI for Leaders, una comunidad de LinkedIn diseñada para fomentar la conversación entre expertos y líderes tecnológicos con ideas afines.

SOBRE LOS AUTORES

Elizabeth M. Renieris es editora invitada del programa MIT Sloan Management Review Responsible AI Big Idea y directora fundadora del Notre Dame-IBM Technology Ethics Lab. David Kiron es director editorial de MIT Sloan Management Review. Steven D. Mills es director general, socio y jefe de ética de la IA en Boston Consulting Group.

Síguenos en Google Noticias para mantenerte informado

Te recomendamosElizabeth M. Renieris, David Kiron y Steven D. Mills

Elizabeth M. Renieris es editora invitada del programa MIT Sloan Management Review Responsible AI Big Idea y directora fundadora del Notre Dame-IBM Technology Ethics Lab. David Kiron es director editorial de MIT Sloan Management Review. Steven D. Mills es director general, socio y jefe de ética de la IA en Boston Consulting Group.y recibe contenido exclusivo